14.7 选择随机森林中的重要特征

问题描述

在随机森林中进行特征选择。

解决方案

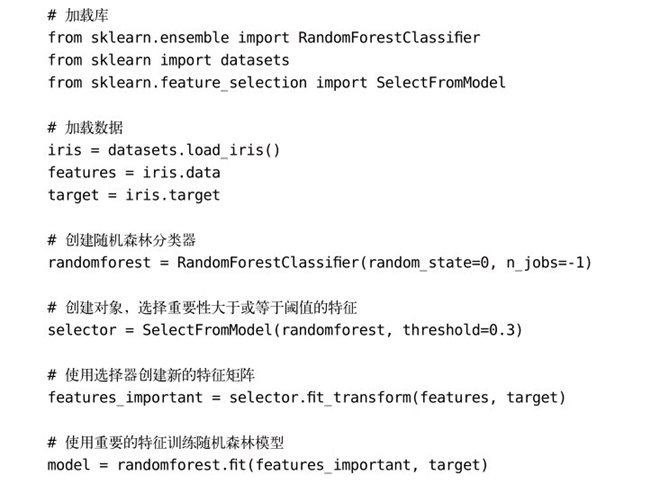

确定重要的特征,并使用它们重新训练模型:

讨论

在某些情况下,你可能希望减少模型中特征的数量。例如,想减少模型的方差或者希望仅使用少数重要的特征来提高模型的可解释性。

在scikit-learn中,可以使用一个简单的两步工作流来创建一个使用较少特征的模型。首先,使用所有特征训练一个随机森林模型,并使用训练得到的模型来确定重要的特征。接下来,创建一个仅包含这些重要特征的新特征矩阵。本节的解决方案使用了SelectFromModel方法来创建特征矩阵,其中仅包含重要性大于或等于某阈值的特征。最后,使用这些特征创建一个新模型。

这种方法中有两点需要注意:第一,经过one-hot编码的nominal型分类特征的重要性被稀释到二元特征中;第二,一对高度相关的特征,其重要性被集中在其中一个特征上,而不是均匀分布在这两个特征上。

延伸阅读

●《使用随机森林进行特征选择》(Robin Genuer、Jean-Michel Poggi、Christine Tuleau-Malot,http://bit.ly/2FvG70D)

本书评论