从神经网络到人工智能

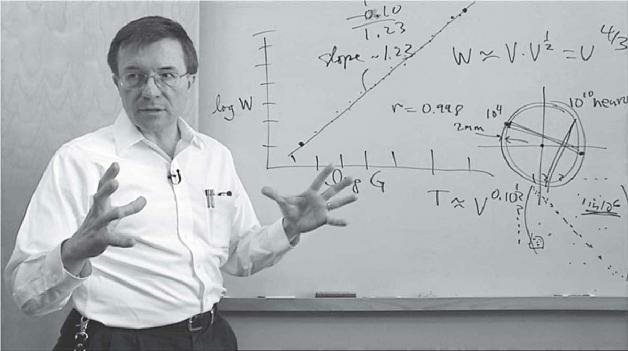

1989年,MIT计算机科学实验室主任迈克尔·德图佐斯(Michael Dertouzos)邀请我到MIT做一个有关我在基于神经网络的人工智能领域采用的开拓性研究方法的“杰出学者讲座”(图2–4)。到场后,我受到了德图佐斯的热情接待。乘电梯时他告诉我:“MIT有个传统,杰出学者讲座的演讲者需要在午餐时用5分钟的时间与教师和学生一起讨论他的讲座话题。”“而且,”当电梯门打开时,他补充道,“他们挺反感你在做的事情。”

图片来源:Ciencia Explicada。

房间里挤满了差不多一百人,德图佐斯也很意外。科学家们站成一个圈,足足有三层:高级教员在第一层,第二层是初级教员,学生在最后一层。我走到圆圈的中心,正对着自助餐的主菜。我要在这5分钟里说些什么,才能让那些讨厌我工作的人改变想法呢?

我开始即兴发挥,“食物上这只苍蝇的大脑只有10万个神经元;它大概重1毫克,要消耗1毫瓦的能量,”我边说边驱赶苍蝇,“苍蝇能看,能飞,可以自己确定飞行方向,还能觅食。但最不可思议的是,它可以通过繁殖来进行自我复制。MIT拥有一台价值1亿美元的超级计算机:它消耗的能量是兆瓦级的,并需要一台巨型空调进行冷却。但是,超级计算机的最大成本是要消耗大量人力,也就是说程序员要满足它对程序的巨大需求。这台超级计算机不能看,不能飞,虽然它能与其他计算机交流,但它不能交配或自我复制。看得出这个场景描述里有什么问题吗?”

在一段长时间的沉默之后,一位高级教员说道:“因为我们还没有编写视觉程序。”(美国国防部最近向其战略计算计划注入了6亿美元,这项计划在1983—1993年间运行,但是缺少了为自动驾驶坦克创建的视觉系统)。[9] 我的回答是“祝你好运”。

在座的有杰拉德·苏斯曼(Gerald Sussman),他为用人工智能解决现实世界的问题做出了几个重要的应用,其中包括高精度轨道力学积分系统,为MIT致敬图灵经典杰作的AI实现方法挽回了尊严(图灵曾证明图灵机,即一个思维实验,可以计算任何可计算的函数)。“那需要多长时间?”我问。“你最好算快一点,否则就要有麻烦了。”我补充道,然后走到房间另一头给自己倒了一杯咖啡。我与教员的对话就这样结束了。

“这个场景出了什么问题?”是我实验室的每个学生都能回答的问题。但是在午餐时间,前两排观众都被难倒了。最后,第三排的一名学生这样回答:“数字计算机是一种通用设备,它可以被编程来计算任何东西,虽然效率很低,但苍蝇是一种专用计算机,可以看和飞,但无法平衡我的账户收支。”这就是正确答案。苍蝇眼中的视觉网络进化了数亿年,其视觉算法嵌入了它本身的网络。这就是为什么你可以利用苍蝇眼神经回路的布线图和信息流对视觉系统进行逆向工程,以及为什么你不能在数字计算机上这样做,因为硬件本身需要软件来指定要解决什么问题。

我认出了在人群中微笑的罗德尼·布鲁克斯(Rodney Brooks)。我曾经邀请他参加在马萨诸塞州鳕鱼角的伍兹霍尔市(Woods Hole)举办的计算神经科学研讨会。布鲁克斯是澳大利亚人,20世纪80年代,他是MIT AI Lab的初级教员。那段时间他使用不依赖数字逻辑的构架搭建了爬行昆虫机器人。他后来成了实验室主管,随后又创建了打造出Roombas的公司iRobot。

那天下午我做演讲的房间很大,挤满了本科生,新生代想要展望未来,而不是徘徊在过去。我谈到了一个学习如何玩西洋双陆棋的神经网络,这是一个与伊利诺伊大学香槟分校(the University of Illinois in Urbana-Champaign)复杂系统研究中心(Center for Complex Systems Research)的物理学家杰拉德·特索罗(Gerald Tesauro)合作的项目。西洋双陆棋是两名玩家之间的比赛,棋子根据掷骰子的点数向前移动,在途中可以跳过对方的棋子。与具有确定性的国际象棋不同,西洋双陆棋是由偶然因素控制的:每次掷骰子的不确定性都使得对特定棋步结果的预测更加困难。这是一款在中东地区非常受欢迎的游戏,其中一些人以玩高赌注的比赛为生。

考虑到有10²⁰ 个可能的西洋双陆棋棋盘摆法,基于逻辑和试探法编写程序来处理所有可能的摆法将会是一个不可能完成的任务。于是,我们让神经网络观看教师对局,通过模式识别来学习下棋。[10] 杰拉德后来让西洋双陆棋网络通过跟自己下棋进行学习,创建了第一个世界冠军级别的西洋双陆棋程序(第10章会详细讲述这个故事)。

演讲结束之后,我听说那天早上《纽约时报》有一篇关于政府机构如何大幅削减人工智能资金投入的头版文章。虽然对主流AI研究人员来说,寒冬已经来临,但它并没有影响到我和我的研究组成员,对我们来说,神经网络的春天才刚刚到来。

然而我们新的AI实现方法需要25年的时间才能在视觉、语音和语言方面提供实际应用。即使在1989年,我也知道这需要很长时间。1978年,我还在普林斯顿大学读研究生时就在想,按照摩尔定律,计算机的运算能力会呈指数级增长,每18个月翻一番,那达到大脑的计算能力需要多长时间?我的结论是,到2015年会实现。幸运的是,这并没有阻止我继续探索。我对神经网络的信仰是基于我的直觉,即如果大自然解决了这些问题,我们也应该能够从大自然中学习到同样的解决方法。而我不得不耐心等待的这25年,与自然界的数亿年相比,它仅仅只是一个瞬间。

在视觉皮层内部,神经元呈多层次排列结构。随着感官信息在皮层间层层传递,对世界的呈现也变得越来越抽象。几十年来,随着神经网络模型层数的增加,其性能也在不断提高,直到最终达到了一个临界点,让我们能够解决在20世纪80年代只能幻想却无法解决的问题。深度学习可以自动找出能区分图像中不同物体的优质特征的过程,这就是今天的计算机视觉比5年前好得多的原因。

到2016年,计算机的运行速度已经快了上百万倍,计算机内存也从兆字节升级到了太字节(terabytes)。与20世纪80年代只有数百个单元和数千个连接的网络相比,现在模拟出的神经网络具有数百万个单元和数十亿个连接。尽管按照拥有数千亿个神经元和千万亿个突触连接的人类大脑的标准来看,这个数字仍然很小,但现有神经网络的规模已经可以在有限领域中进行原理的证明。

基于深度神经网络的深度学习已经出现了,但在有深度网络之前,我们必须学习如何训练浅层网络。

- 虽然直到1970年才正式成立,麻省理工学院人工智能实验室(MIT AI Lab)于 1959年就开始了相关的研究项目,并于2003年跟麻省理工学院计算机科学实验室(LCS)合并,组建了麻省理工学院计算机科学与人工智能实验室(CSAIL)。为了保持简洁和一致性,我把该机构统称为“MIT AI Lab”。

- 参阅Seymour A. Papert, “The Summer Vision Project,” AI Memo AIM-100, July 1, 1966, DSpace@MIT, https://dspace.mit.edu/handle/1721.1/612.。根据麻省理工学院2016级毕业生Michaela Ennis的说法:“有关麻省理工学院本科生被安排将‘计算机视觉’作为暑期研究项目的故事,帕特里克·温斯顿(Patrick Winston)教授每年都会拿到课堂上讲,他还说过这个本科生就是杰拉德·苏斯曼(Gerald Sussman)。”

- 参阅Roger Peterson, Guy Mountfort, and P. A. D. Hollom, Field Guide to the Birds of Britain and Europe,5th ed. (Boston: Houghton Mifflin Harcourt, 2001).

- Bruce G. Buchanan and Edward H. Shortliffe, Rule Based Expert Systems: The MYCIN Experiments of the Stanford Heuristic Programming Project (Reading, MA:Addison-Wesley, 1984).

- S. Mukherjee, “A.I. versus M.D.: What Happens When Diagnosis Is Automated?”New Yorker , April 3, 2017.

- Pedro Domingos, The Master Algorithm: How the Quest for the Ultimate Learning Machine Will Remake Our World (New York: Basic Books, 2015), 35. 甚至没有人知道如何量化所有常识,我们把拥有常识当成理所当然的事。

- 猫比人的体重要轻,即使背朝下掉落,也可以在空中翻转过来四肢着地。J.A. Sechzera, S. E. Folsteina, E. H. Geigera, R. F. and S. M. Mervisa, “Development and Maturation of Postural Reflexes in Normal Kittens,” Experimental Neurology 86, no. 3 (1984): 493–505.

- B. Katz, Nerve, Muscle, and Synapse (New York: McGraw-Hill, 1996): A. Hodgkin,Chance and Design: Reminiscences of Science in Peace and War (Cambridge:Cambridge University Press,1992).

- M. Stefik, “Strategic Computing at DARPA: Overview and Assessment,”Communications of the ACM 28, no.7 (1985): 690–704.

- G. Tesauro and T. J. Sejnowski, “A Parallel Network That Learns to Play Backgammon,” Artificial Intelligence 39 (1989): 357–390.

本书评论