布鲁克斯革命

要理解布鲁克斯的观点,我们得重新回到积木世界。回想一下,积木世界是一种由各种模拟元素组成的桌面,桌面上堆叠着不同的对象——人工智能的任务则是以特定的方式重新排列对象。乍一看,积木世界作为人工智能的试验场是完全合情合理的:它听起来像是一个丰富的仓库环境,我敢肯定,多年来人工智能研究的诸多提案中也明确提到了这一点。但对布鲁克斯以及他的追随者而言,积木世界是没有意义的。原因很简单,它的积木只是模拟元素,而现实世界中的问题比模拟元素组成的积木复杂得多。能够在积木世界里解决问题的系统,无论它看起来有多么智能,回归到现实的仓库环境中,都毫无价值。因为在物理世界中,人工智能面临的真正困难是处理感知问题,而在积木世界中,感知问题完全被忽略。(在20世纪70至80年代,积木世界最终被确认为人工智能研究谬误的发展方向,然而这并没有使人们停止对积木世界的研究,即使在今天,我们仍然可以找到各种有关积木世界的研究论文。我承认,我自己也写过几篇。)

布鲁克斯提出了三个关键原则,确定了他的理论体系:首先,他确信,人工智能要取得有意义的进步,只能通过与现实世界中的系统互动来实现——它们必须直接处于某个现实环境,感知并与之互动。其次,他认为,不管是以知识还是以逻辑为基础的人工智能,清晰而全面的知识储备及推理并不是它们智慧行为产生的必要条件,尤其是以逻辑为基础的人工智能。最后,他认为,智慧是一种涌现性质[7] ,来源于实体与它所处环境发生的各种交互行为。布鲁克斯用了一个发表于1991年的讽刺寓言来阐明自己的观点[44] :

假设19世纪90年代爆发了研究人工飞行(Artificial Flights, AF)的热潮,科学界、工程界和风险投资界都疯狂投入其中。一群AF研究人员奇迹般地乘上了时间机器,穿越到20世纪80年代,在一架商用波音747飞机的客舱里度过了难忘的几个小时。回到19世纪90年代,他们感到无比兴奋和狂热,毕竟确定了空中飞行是能够实现的。于是,他们立即着手研究所看到的一切,在设计倾斜座椅、双层玻璃方面取得了巨大的进步。AF研究员们坚信,只要研究出那些神奇的“塑料”,就能在人工飞行领域登顶称王。

这个寓言的重点在于,当我们思考人类智慧有关问题的时候,往往更关注那些迷人的、具象的方面,比如推理、解决问题或者下棋等智力活动。这些是学术界重视并且希望人工智能可以擅长的领域——相关研究也因为这样的偏向性而走了弯路。布鲁克斯和他的团队认为,推理和解决问题的能力或许会在智能行为中起到作用,但它们并不是研究如何构建人工智能的正确起点[45] 。

回到布鲁克斯的寓言中,他还对“分而治之”的设定提出了异议,这一设定是自人工智能诞生之初就默认的基础:人们认为应该将人工智能行为分解为各个组成部分(推理、学习、感知)来研究,而忽略了这些组件如何协同工作:

(人工飞行研究人员)一致认为,这个项目太大了,不可能由单一团体完成,而且他们必须成为不同领域的专家。毕竟,在穿越的那几个小时里面,他们询问过同机乘客,波音公司可是要雇用超过6000人来制造这么一架飞机呢。

……每个人都忙得不可开交,但是小组之间并没有太多交流。

最后,他指出那群研究人员天真地忽视了“重量”问题,他在寓言中写道:

……制造座椅的人用了最好的实心钢作为骨架,有人就犯嘀咕了,应该用空心钢管做啊,这样明显会减轻不少重量。可是众所周知,如果这么一架又大又重的飞机能够在天上飞行,这点重量只是九牛一毛。

这里的“重量”,布鲁克斯是在暗喻计算量。特别是,他强烈反对将所有的决策过程都简化成逻辑推理这种需要大量消耗计算机处理时间和内存的想法。

布鲁克斯为这则寓言选择的题目是“无表征智能”。作为一名研究人工智能的大学生,在20世纪80年代中期专家系统蓬勃发展的阶段,我所接受的教育都认为逻辑推理才是人工智能的核心。布鲁克斯的文章似乎从根本上否定了我以为自己所知道的有关这个领域的一切,感觉就像是异端。1991年,一名年轻的同事从澳大利亚大型人工智能研讨会上回来,兴奋地瞪大眼睛告诉我,斯坦福大学(麦卡锡故乡学院)和麻省理工学院(布鲁克斯所在学院)的博士生之间展开了一场激烈的辩论。一方坚持既定的传统——逻辑、知识表述和推理;另一方则倡导新的人工智能运动,他们不仅无礼地、公然地背弃了神圣的传统,还大肆地嘲笑它。

布鲁克斯或许是新研究方向知名度最高的倡导者,但他并非孤军奋战。也有许多研究人员得出类似结论,虽然在细节上有所偏差,但在不同的研究方法得到的最终的结果相当一致。

其中最重要的一点,是将知识和推理从人工智能的核心角色中抹去。在麦卡锡的人工智能系统设想中,逻辑模型是其核心,所有的人工智能行为都围绕这一核心进行(如上一章的图8所示),而这个设想遭到了强烈抨击。当然也有一些比较中立的观点,认为推理和知识表述仍然可以在人工智能系统中发挥一定作用,虽然可能不是核心和主导作用。但更极端的声音认为应该完全摒弃它们。

这一点值得详细探讨。我们来回顾一下麦卡锡的逻辑派人工智能系统遵循的特定循环:感知其所在环境,推理其该做什么,然后采取行动。但是,以这种方式运行的系统,与环境是分离的。

现在,放下手里的这本书,花点时间四下观察。你可能身处候机室、咖啡厅、火车车厢、家里,或者躺在阳光下的小河边。当你环顾四周时,并没有从环境中脱离,你的感知和行为是与环境融为一体并保持协调的。当然,在某些情况下,你会脱离眼前的环境,陷入沉思。但这种情况并非常规状态,只能算偶然现象。

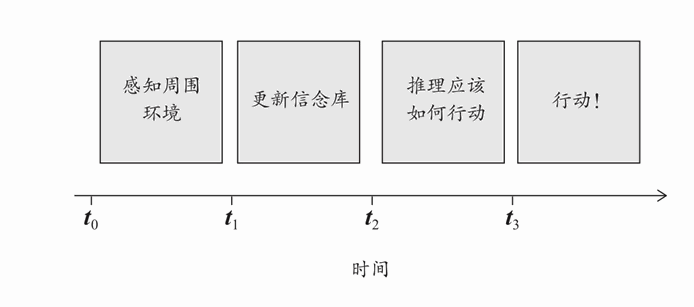

问题在于,基于知识的人工智能并没有反映出这一点。假设我给你介绍一个按照麦卡锡模型的逻辑人工智能设计的机器人,它通过一个持续的“感知—推理—行为”循环模式运行,利用处理器处理和解析感应器接收到的数据,将感知数据更新到信念库,然后推理应该进行什么操作,再执行它选择的行为,然后再次启动决策循环。现在,我自豪地告诉你,我设计的机器人,不管在执行什么任务,总是会选择最优的执行方式。让我们考虑一下这个机器人在一段时间里的运行模式:

机器人应当选择最合适的行动时间,但是具体是什么时间呢?是感知周围环境的时候,还是最终决定执行什么操作的时候?

在t0 到t1 之间,机器人感知周围环境,然后用t1 到t2 的时间来处理传感器数据并更新信念库。在t2 到t3 之间,机器人对需要执行的动作进行推理,最后,t3 才是机器人开始行动的时间点。

现在我宣称自己设计的机器人总是采取最优的执行策略,但是想出最优策略对应的时间呢?是t1 还是t3 ?机器人所掌握的环境信息是在t1 之前的,但在t3 以后它才可以基于这些信息开始正式行动。这种方法其实是不切实际的,但令人惊讶的是,直到20世纪80年代末,几乎所有的人工智能都还在沿用这样的方式:人工智能研究者一直致力于制造能够在理论上做出最佳抉择的机器(前提是假设外部环境不会发生变化,同时又能弄清楚它到底应该做什么),而不是实践中的最佳决策[46]。

因此,当时出现了另一个关键性的研究主题,即人工智能系统所处的环境和它所表现的行为之间,应该存在一种紧密的耦合关系。

本书评论